Jan T. Grusznic

Choć trudno to przyznać, niemal każdy system dozoru wizyjnego jest budowany z myślą o analizie zdarzeń post factum, w którym obraz z kamery stanowi nieprzetworzoną i wierną informację dotyczącą zajścia, tak istotną dla szybkiego wyjaśniania zdarzeń. Niemniej takie potraktowanie systemu dozoru wizyjnego, zwłaszcza w ujęciu bezpieczeństwa publicznego, kłóci się z ogólną koncepcją Wielkiego Brata, który obserwuje, czuwa i stara się zapobiec najgorszemu. Okazuje się, że nie zawsze, a w zasadzie sporadycznie i nie wszędzie. A to z kolei wpływa na dobór urządzeń wykorzystywanych w systemie monitoringu.

Raport

Niedawno trafiłem na raport 1) o inteligentnych miastach przygotowany przez Departament Planowania Przestrzennego z Politechniki Wiedeńskiej. Dokument jest dostępny w formie interaktywnej i umożliwia wykonanie zestawienia miast oraz zaprezentowanie tych interesujących na tle pozostałych. Badania dotyczyły wybranych aglomeracji z liczbą mieszkańców w przedziale od pięciuset tysięcy do miliona.

Zwróciłem uwagę na wysoki wskaźnik indywidualnego poczucia bezpieczeństwa we wszystkich analizowanych polskich miastach – jeden z wyższych w Europie. Trudno to przełożyć bezpośrednio na fakt posiadania systemu dozoru wizyjnego, ten aspekt bowiem nie został wyszczególniony.

Inną sprawą jest brak wskaźników skuteczności zainstalowanego systemu monitoringu, gdyż większość polskich miast w ogóle ich nie stosuje2). W niewielu przypadkach, gdzie taka obserwacja została poczyniona, wykazano spadek przestępczości w zakresie od 7 do 90 proc. a policja wykazała wzrost wykrywalności przestępstw w wybranych lokalizacjach kamer3).

Magia kamer obrotowych

Większość systemów dozoru wizyjnego miast została zdominowana przez kamery szybkoobrotowe lub stałopozycyjne zainstalowane na głowicach uchylno-obrotowych. Wynika to głównie z dość elastycznej funkcji tych kamer, które mogą stanowić stałopozycyjny punkt kamerowy i obserwować przez dłuższy czas stały fragment miasta, a jednocześnie wykonać precyzyjną obserwację zdarzenia ze znacznej odległości, gdy zajdzie taka potrzeba. Alternatywnie wykorzystuje się trasy dozorowe po zaprogramowanych wcześniej pozycjach lub odtwarzających ciąg zmiennych zapamiętanych jako tura operatora. Niezależnie od typu uruchomionej trasy patrolowej kamera jest w ciągłym ruchu, dozorując dynamicznie przestrzeń wokół punktu kamerowego. Oba rozwiązania mają zalety i wady.

W pierwszym przypadku obszar obserwacji jest znany, kamera bowiem zawsze wraca do punktu wyjściowego po zadanym czasie, gdy nie jest wykorzystywana przez użytkownika. Dzięki temu utrzymywana jest ciągłość obserwacji wcześniej zdefiniowanej strefy, a materiał archiwalny zwykle dotyczy zdarzeń zaobserwowanych właśnie na określonym obszarze. Periodycznie wykorzystuje się funkcję zmiany pozycji i ogniskowej, a wtedy taki materiał automatycznie jest oznaczany w systemie jako manualne przejęcie kontroli nad kamerą. Dzięki temu użytkownik potrafi szybko wskazać miejsca na osi czasu, gdy kamera była w ruchu, i szybko je przejrzeć albo też zignorować w przypadku wyszukiwania zdarzeń, wykorzystując automatyczną analizę obrazu w materiale archiwalnym.

W przypadku kamer poruszających się po trasie patrolowej wyróżnia się dwa jej typy: po pozycjach zaprogramowanych (presetach) oraz turę zaprogramowaną przez użytkownika w formie ciągłego ruchu. Ta druga wersja stanowi nagranie koordynat (najczęściej obrót, pochylenie, zoom) z odpowiednią częstotliwością (gęstość zapisu nie powinna być rzadsza niż raz na 1/15 s), które wynikają bezpośrednio z ruchu wskaźnikiem myszy po obrazie lub za pomocą manipulatora. Ruch w tym przypadku jest płynny w całym przebiegu trasy od jej początku do końca, a wszelkie przestoje w wybranych miejscach trasy są jej integralną częścią. Trasa dozorowa wykorzystująca presety należy do ruchu interwałowego, tj. w konkretnych cyklach zmieniają się koordynaty ustawienia kamery (najczęściej obrót, pochylenie, zoom, ostrość, czasami również wartość przysłony). Czas przebywania w presecie może się różnić w zależności od potrzeb i celu obserwacji, czas przejścia między kolejnymi pozycjami natomiast na ogół jest jak najszybszy. Kamera po przejściu do kolejnego presetu zachowuje się jak kamera stałopozycyjna, tj. przez określony czas obserwuje wybraną scenę.

Praca z trasami dozorowymi łączy się z ograniczoną w czasie obserwacją wybranej przestrzeni. Oznacza to, że pomimo teoretycznie dużego pokrycia terenu obserwowany jest tylko wycinek obszaru przez względnie krótki okres, co znacznie redukuje możliwość wykrycia anomalii przez algorytmy analizujące zawartość obrazu (VCA) czy nawet przez przeszkolonego operatora. W przypadku materiału archiwalnego odnalezienie konkretnego zdarzenia bez znajomości dokładnych parametrów czasowych wymaga więcej uwagi i… czasu, ponieważ materiał w żaden sposób nie jest znakowany. Oznacza to, że dane wizyjne muszą być przejrzane przez użytkownika tradycyjnie. Inną sprawą jest brak pewności, czy incydent w ogóle został zarejestrowany, ponieważ kamera odtwarzająca turę operatora mogła znajdować się w zupełnie innym położeniu.

Praca z trasami dozorowymi łączy się z ograniczoną w czasie obserwacją wybranej przestrzeni. Oznacza to, że pomimo teoretycznie dużego pokrycia terenu obserwowany jest tylko wycinek obszaru przez względnie krótki okres, co znacznie redukuje możliwość wykrycia anomalii przez algorytmy analizujące zawartość obrazu (VCA) czy nawet przez przeszkolonego operatora. W przypadku materiału archiwalnego odnalezienie konkretnego zdarzenia bez znajomości dokładnych parametrów czasowych wymaga więcej uwagi i… czasu, ponieważ materiał w żaden sposób nie jest znakowany. Oznacza to, że dane wizyjne muszą być przejrzane przez użytkownika tradycyjnie. Inną sprawą jest brak pewności, czy incydent w ogóle został zarejestrowany, ponieważ kamera odtwarzająca turę operatora mogła znajdować się w zupełnie innym położeniu.

W przypadku wykorzystania trasy po presetach istnieje możliwość automatyzacji pracy operatora oraz sposobu przeglądu materiału archiwalnego. Każda pozycja kamery PTZ jest bowiem programowana z konkretnego powodu, wynikającego z analizy zdarzeń, ryzyka, liczby zgłoszeń lub interwencji itp.

Operator dla każdego presetu ma scenariusze, na co zwracać uwagę. W Częstochowie np. każda kamera ma kartę, w której zostały opisane cele i priorytety dozoru oraz miejsca szczególnego zainteresowania. Operator jest zobowiązany do patrolowania tych miejsc za pomocą kamery i ich oznaczania w zapisie obrazu, kiedy kieruje na nie obiektyw. Proces ten jest podstawowym kryterium oceny jego pracy. Zmusza to zatem zatrudniony personel do gruntownego poznania obszarów objętych dozorem i uważnego przyglądania się miejscom, w których dochodzi do zagrożeń. W efekcie operatorzy mają także okazję obserwować zachowania ludzi, którzy przebywają w tych miejscach. W związku z tym prawdopodobieństwo, że zauważą niepokojące sygnały, się zwiększa [4].

A co w przypadku, gdy operatorów jest mniej niż kamer? Otóż kamera ustawiona w presecie może ten fakt oznaczać automatycznie w materiale archiwalnym. Dzięki temu możliwy jest przegląd nagrań tylko tych obrazów, które są związane z daną pozycją zaprogramowaną. Stanowi to niewątpliwą korzyść wynikającą z przyspieszenia analizy materiału archiwalnego, ograniczonego tylko do scen, którymi jesteśmy zainteresowani. Przykładowo, jeśli trasa dozorowa ma 12 presetów, a kamera pozostaje w każdym z nich przez 5 min, oznacza to, że wykonanie pełnej trasy trwa 1 godzinę. Zamiast przeglądać cały materiał, można odnaleźć tylko sekwencje skojarzone z miejscami znajdującymi się w kręgu zainteresowania. Jeśli jest to jedna scena, oznacza to przegląd tylko 5 min zapisu archiwalnego, nie zaś całej godziny. Wyszukanie materiału ogranicza się natomiast do wyszukania oznaczonego nagrania z numerem pozycji zaprogramowanej i zakresu czasu.

Czas wysokich rozdzielczości

Jako rezultat analizy ostatnich incydentów o charakterze terrorystycznym w miastach Europy Zachodniej zalecono wprowadzenie zmian w miejskich wizyjnych systemach dozoru. Oprócz wciąż popularnych kamer szybkoobrotowych zaczęły pojawiać się kamery stałopozycyjne o rozdzielczości znacznie przewyższającej standard 2160p. Takie modele zostały już zainstalowane w punktach gromadzenia się osób w Berlinie po wydarzeniu przed Bożym Narodzeniem zeszłego roku. Dzięki wysokiej rozdzielczości użytkownicy systemu są w stanie na bieżąco monitorować tłum oraz, jeśli to potrzebne, powiększać cyfrowo wybrane części obrazu w celu odczytania szczegółów, nie tracąc jednocześnie ogółu z podglądu. Jest to niewątpliwa przewaga nad kamerami PTZ, które realizując zbliżenia, nie mogą utrzymać w dozorze ogólnego planu. Zasięg detekcyjny kamer o wyższej rozdzielczości w porównaniu do 1080p oczywiście będzie większy. Dla tego samego kąta obserwacji (67⁰) kamera np. 20 Mpix umożliwia rozpoznanie (8 mm/pix) z odległości 33 m, podczas gdy kamera full HD – z 12 m. PTZ jednak zyskują przewagę dzięki wielokrotnemu zbliżeniu optycznemu, co umożliwia rozpoznanie osoby z odległości ponad 370 m (zoom 30x) i w tym są trudne do zastąpienia. Cały czas jednak za pomocą kamer PTZ trudno obserwować ogólny plan i detale jednocześnie.

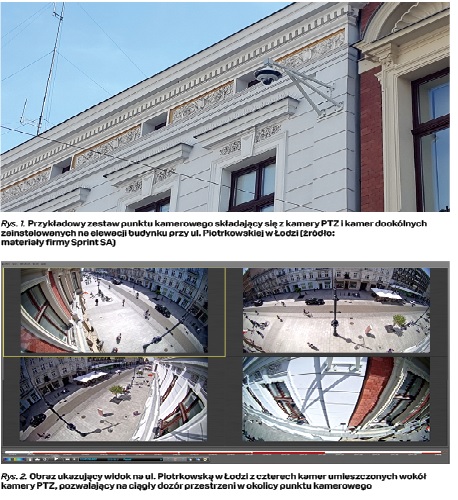

Problem znany od dawna niedawno znalazł rozstrzygnięcie. Producenci kamer zdecydowali się wprowadzić do oferty rozwiązanie uzupełniające w postaci dodatkowych kamer stałopozycyjnych instalowanych dokoła jednostki PTZ (rys. 1). Kamery te są dostępne w postaci dodatkowego modułu nakładanego na kamerę PTZ lub już w wersji zintegrowanej, a ich rolą jest niezależny dozór najbliższej przestrzeni wokół punktu kamerowego (rys. 2). Za pomocą tego modułu możliwe jest sterowanie kamerą PTZ z obrazów kamer stałopozycyjnych oraz oznaczenie na nich pozycji kamery szybkoobrotowej. Sumaryczna rozdzielczość takich modułów kamerowych sięga 8 Mpix, co nazwałbym obecnie standardem. Nie jest to rozwiązanie rewolucyjne, ale idące z duchem czasu i wynikające z wymagań użytkowników. Rewolucyjnym natomiast można nazwać rozwiązanie zaprezentowane przez firmę Canon na targach EXPO w Paryżu w 2015 r. Wówczas koncern pokazał matrycę CMOS zawierającą blisko 250 mln aktywnych pikseli.

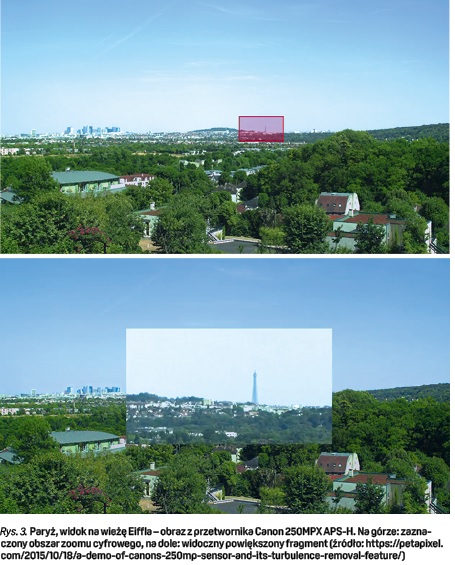

Już podczas targów rozważano zastosowanie tej technologii głównie w wyspecjalizowanych narzędziach dozoru i zapobiegania przestępczości, przyrządach pomiarowych o wysokiej rozdzielczości i innym sprzęcie przemysłowym [5]. Przetwornik obrazu wielkości APS-H (29,2 x 20,2 mm) dostarcza obrazy o wymiarach 19580 x 12600 pix. Wielkość pojedynczego piksela wynosi ok. 1,6 µm, czyli podobnie jak dla przetworników o wielkości 1/3” i rozdzielczości 4K. Czas odczytu danych z matrycy wynosi 1,25 mld pikseli na sekundę, co w przeliczeniu na liczbę klatek dla podanej rozdzielczości przekłada się na 5 kl./s. Canon zapewnia, że ujęcia wykonane za pomocą nowatorskiego przetwornika zapewniają odczytanie numerów samolotu z odległości 18 km (przy wykorzystaniu obiektywu o ogniskowej 800 mm).

Tak wysokie rozdzielczości nie są pozbawione wad. Wymagają bowiem wykorzystania większej optyki, efekt dyfrakcji szybciej przybiera na sile ze względu na zmniejszenie powierzchni piksela, głębia ostrości jest zdecydowanie krótsza, ponieważ zwęża się wraz ze wzrostem wielkości przetwornika, a ruchy mas powietrza skutecznie obniżają jakość obrazu przy obserwacji z dużej odległości. A jednak zaprezentowane możliwości promowanego produktu udowodniły zasadność kontynuowania prac nad rozwojem takich matryc i pokonywania kolejnych trudności z nimi związanych. Przykłady możliwości można zobaczyć na rys. 3 – odległość od punktu instalacji kamery do wieży Eiffla wynosi 20 km.

Na zastosowanie produkcyjne przyjdzie nam pewnie jeszcze trochę poczekać. Chwilowo tak wysokie rozdzielczości osiąga się przez przetwarzanie obrazów z wielu kamer jednocześnie najczęściej o rozdzielczości nie wyższej niż 4K, zgromadzonych w jednej obudowie. Każda kamera strumieniuje obraz niezależnie, który następnie jest „klejony” po stronie stacji klienckiej (tzw. stitching). Tak spreparowany obraz jest prezentowany na ekranie jako jeden, dając możliwości przybliżania cyfrowego. Niewątpliwie koncepcja stitchingu pozwala na uzyskanie większej głębi ostrości, zróżnicowanie ogniskowych w zakresie pola obserwacyjnego, zastosowanie mniejszych przetworników i dzięki temu obiektywów. Niestety, aby móc w pełni korzystać z zalet takiej kamery, należy dysponować konkretnym oprogramowaniem producenta. Próba integracji z innymi platformami skutkuje podłączeniem każdej kamery niezależnie i podglądem strumieni wizyjnych jak w przypadku tradycyjnych źródeł obrazu. Kamery wieloprzetwornikowe wymagają odpowiedniego zaprojektowania instalacji, w tym precyzyjnego ustawienia punktów ostrości. Stąd nie są to rozwiązania z tzw. półki, tak jak w przypadku kamer PTZ czy też wysokorozdzielczych kamer jednoprzetwornikowych.

Na zastosowanie produkcyjne przyjdzie nam pewnie jeszcze trochę poczekać. Chwilowo tak wysokie rozdzielczości osiąga się przez przetwarzanie obrazów z wielu kamer jednocześnie najczęściej o rozdzielczości nie wyższej niż 4K, zgromadzonych w jednej obudowie. Każda kamera strumieniuje obraz niezależnie, który następnie jest „klejony” po stronie stacji klienckiej (tzw. stitching). Tak spreparowany obraz jest prezentowany na ekranie jako jeden, dając możliwości przybliżania cyfrowego. Niewątpliwie koncepcja stitchingu pozwala na uzyskanie większej głębi ostrości, zróżnicowanie ogniskowych w zakresie pola obserwacyjnego, zastosowanie mniejszych przetworników i dzięki temu obiektywów. Niestety, aby móc w pełni korzystać z zalet takiej kamery, należy dysponować konkretnym oprogramowaniem producenta. Próba integracji z innymi platformami skutkuje podłączeniem każdej kamery niezależnie i podglądem strumieni wizyjnych jak w przypadku tradycyjnych źródeł obrazu. Kamery wieloprzetwornikowe wymagają odpowiedniego zaprojektowania instalacji, w tym precyzyjnego ustawienia punktów ostrości. Stąd nie są to rozwiązania z tzw. półki, tak jak w przypadku kamer PTZ czy też wysokorozdzielczych kamer jednoprzetwornikowych.

Big Data rozwiązaniem na rosnącą liczbę danych wizyjnych?

Raport NIK dotyczący systemów monitoringu miejskiego dość brutalnie punktuje sposób wykorzystania systemów kamer zainstalowanych w przestrzeni publicznej. Wśród wielu uchybień pojawia się niski poziom wykrywalności wynikający głównie z przypisania zbyt wielu kamer jednemu operatorowi. Tymczasem operatorzy systemu dozoru wizyjnego w miastach uważają, że maksymalna liczba obrazów, jakie są w stanie efektywnie monitorować, wynosi 16. Nieco ponad połowa operatorów uważa nawet, że nie powinna przekraczać od 1 do 4 [6]. Dane eksperymentalne wskazują, że wraz ze wzrostem liczby nadzorowanych kamer maleje efektywność pracy obserwatorów próbujących wykryć pojawiające się zdarzenia. Wnioski te idą w parze z wynikami badań Ticknera i Poultona, którzy porównywali efektywność pracy przy zwiększającej się liczbie monitorów. Przy 4, 9 i 16 monitorach pokazujących bardzo ruchliwe obszary miejskie skuteczność działań operatorów przy wykrywaniu postaci wyniosła odpowiednio: 93, 84 i 64 proc. [7]. Współczesny system monitoringu wizyjnego charakteryzuje się ciągłym wzrostem liczby instalowanych kamer, a obecnie wzrostem ich rozdzielczości, a co za tym idzie zwiększeniem liczby szczegółów w obrazie.

Częste przeglądanie dużej liczby takich obrazów w celu uzyskania niezbędnych informacji o obserwowanych obszarach lub szybkiego zidentyfikowania zdarzeń wymagających szczególnej koncentracji sprawia, że długotrwałe prowadzenie obserwacji staje się trudniejsze, a niektóre zadania wymagające skupienia wzroku na szczegółach, np. odczytanie znaków szczególnych na ciele lub ubraniu obserwowanej osoby, są wręcz niemożliwe do wykonywania. Według wytycznych PSDB [8] zaleca się projekcję maksymalnie czterech obrazów na jednym monitorze, jeżeli operator musi skupiać się na szczegółach [9].

Przy powszechnie stosowanych technologiach komputerowych umożliwiających prezentację obrazów na wiele sposobów kładzie się nacisk na rozwiązania zwiększające efektywność pracy operatora. W procesie projektowania systemu kamer powinno się dokładnie rozważać liczbę obrazów z kamer oraz stopień ich szczegółowości do nadzoru przypadających na jednego operatora, a także wykorzystanie systemów wspomagających skuteczność działań podejmowanych przez użytkowników systemu dozoru wizyjnego. Należy mieć świadomość, że ta decyzja będzie miała kluczowe znaczenie dla osiągnięcia przez system zakładanych celów, gdyż istnieją granice efektywnego nadzoru. Jednocześnie należy mieć świadomość, że człowiek nie jest w stanie wszystkiego przeanalizować. Gdybyśmy przeliczyli liczbę danych, jaka dociera do każdego z nas, to według różnych źródeł ta wartość wynosi ok. 109 b/s, czyli ok. 1 Gb/s. Uświadomionych informacji jest jednak tylko niewielka liczba, od 10 do 100 b/s [10].

Mimo że badania PSDB i inne nie podają żadnych rozstrzygających danych dotyczących maksymalnego czasu prowadzenia efektywnej obserwacji przez operatora CCTV, to operatorzy, monitorując obrazy z kamer w centrach miast, stwierdzają, że maksymalny czas obserwacji waha się od 30 min do 2 godz. Jest to złożona kwestia, gdyż czas obserwacji będzie zależał od wielu czynników, nie tylko od tych związanych z wymogami pracy. Przepisy BHP dotyczące ekranów wskazują, aby w celu uniknięcia nadmiernego zmęczenia wywołanego używaniem tego wyposażenia, robić krótkie, częste przerwy, które mają korzystniejszy wpływ niż sporadyczne, dłuższe przerwy [11]. Niestety, koncentracja operatora systemu obserwującego pojedynczą scenę spada liniowo z upływem czasu. Już po 30 min pracy w systemie skuteczność wykrywania zdarzeń przez użytkownika zmniejsza się o 75 proc. [12].

Z tego m.in. powodu algorytmy wyszukujące w danych wideo wzorce zachowań, kształtów, ruchu lub rozmieszczenia punktów szczególnych, stanowią jeden z chętniej wykorzystywanych elementów do szybkiego oznaczania miejsc ich występowania w materiale wizyjnym. Analiza zawartości obrazu, jaką znamy z niektórych filmów szpiegowskich, jest stosowana w profesjonalnych systemach dozoru wizyjnego, również miejskich. Na ich podstawie można bezinwazyjnie określić prawdopodobieństwo posiadania broni lub improwizowanych ładunków wybuchowych, pojedynczego ruchu w tłumie lub przemieszczania się jednostek w przeciwnym kierunku do naturalnego przepływu osób. Możliwa jest również analiza rysów twarzy w większych skupiskach ludzi i porównywanie wyników z konkretną bazą osób. Informacje z analizy same w sobie nie są użyteczne dla użytkownika, jeśli nie zostały powiązane z odpowiednimi procedurami lub innymi danymi i w przystępny sposób zaprezentowane. Rola samego rozkładu obrazu jest ograniczona do dostarczenia informacji będącej podstawą do dalszych działań podejmowanych automatycznie przez system lub świadomie przez użytkownika.

Sposób analizy będzie różnił się w zależności od charakteru poszukiwanych zmian. Każdy algorytm badający zawartość obrazu działa inaczej, ale upraszczając, obraz jest „rozdzielany” na fragment przedstawiający jego „statyczną” część oraz obiekty nienależące do tła. Informacja o każdym obiekcie jest „opisem” miejsca zajętego przez niego w obrazie, wielkości czy wektora ruchu powiązanych ze znacznikiem czasu itp. Te dane przetworzone w ramach Big Data dostarczą nowych informacji wynikających chociażby z połączenia z danymi z innych kamer, czujników czy wiadomości z portali społecznościowych itd.

Big Data to termin odnoszący się do dużych, zmiennych i różnorodnych zbiorów danych, których przetwarzanie i analiza jest trudna, ale jednocześnie wartościowa, ponieważ może prowadzić do pozyskania wiedzy [13]. W przypadku miast celem jest lepsze zrozumienie zachodzących zmian i w konsekwencji lepsze zarządzanie aglomeracją i określenie kierunków rozwoju w przyszłości. Przetwarzanie dużych zbiorów danych otwiera przed nimi zupełnie nowe możliwości. Biorąc przykład tylko z rynku komercyjnego, organizacje przetwarzające w sposób właściwy posiadane dane prześcignęły swoich konkurentów o 5–6 proc. Tymczasem w miastach rozwijających się rzeczywistość jest taka, że operacje są nieskoordynowane, a przechwytywanie danych jest wciąż trudnym procesem ręcznym.

Współczesne środowiska korzystają ze skonsolidowanych usług w różnych obszarach, takich jak zarządzanie zasobami, flotą i personelem. Są tam dostępne odpowiednie informacje ułatwiające utrzymanie ciągłości świadczonych usług, ogólną satysfakcję klientów oraz zrozumienie wąskich gardeł. Jest to możliwe dzięki wdrożeniu hurtowni danych i analiz biznesowych – zasobów ICT (patrz: ramka), które wciąż rozwijają nowoczesne miasta. Wzorzec syntezy danych, stanowiący podstawę tego typu środowiska, pozwala na wykorzystanie różnorodnych źródeł danych, takich jak wideo z kamer dozoru wizyjnego, audio, media społecznościowe, logi czujników, systemy kontroli procesów i zbierania danych (SCADA), tradycyjne struktury i niestrukturyzowane dane, które mają być połączone ze sobą w celu wsparcia wizji miasta [14].

Smart city oparte na kamerach

Droga rozwoju monitoringów miejskich nie jest już dyktowana jedynie troską o bezpieczeństwo mieszkańców, które – jak wskazują oceny – jest zadowalające. Niebawem, jeśli jeszcze nie jest to powszechne, kamery będą należały do serii istotnych czujników, które zbierają informacje pozwalające na szybkie reagowanie. Przykład Londynu jako jednego z trójki miast, które w obszarze smart (obok Paryża i Nowego Jorku) rozwijają się najszybciej, pokazuje, w jaki sposób kamery dozoru wizyjnego pozwoliły osiągnąć to wyróżnienie. Od dłuższego czasu rozwija wizualizację miasta 3D w połączeniu z danymi z kamer CCTV i informacjami o nowych inwestycjach budowlanych, by płynniej zarządzać ruchem w mieście dzięki redukcji nieuzasadnionych robót drogowych oraz utrudnień w ruchu wynikających z tego, że kilka firm budowlanych działa na zbyt bliskim sobie terenie. Mapa 3D aktualizowana w czasie rzeczywistym ma być ukończona do 2020 r. i zostanie wtedy udostępniona wszystkim zainteresowanym firmom.

Londyn wykorzystuje monitoring wizyjny do detekcji wypadków i skrócenia czasu dotarcia na miejsce zdarzenia. Dane są również pomocne w projektowaniu ścieżek rowerowych oraz budowaniu bardziej efektywnych sposobów komunikacji dla pieszych i osób niepełnosprawnych. Korzystając z analizy danych, rozwija transport publiczny w zrównoważony sposób, by doprowadzić w 2020 r. do 50-proc. redukcji zanieczyszczania powietrza przez komunikację miejską. Jeśli się to uda, stolica Wielkiej Brytanii będzie miała najczystsze powietrze wśród wszystkich głównych miast Europy.

Przy okazji – Warszawa w rankingu IESE Cities in Motion zdobyła 74. miejsce na 181 badanych miast [15].

ICT (Information and Communications Technology),

czyli teleinformatykaPojęcie ICT obejmuje szeroki zakres wszystkich technologii umożliwiających przetwarzanie i przesyłanie informacji. W zakres pojęciowy technologii ICT wchodzą wszystkie media komunikacyjne (Internet, sieci bezprzewodowe, sieci Bluetooth, telefonia stacjonarna, komórkowa, satelitarna, technologie komunikacji dźwięku i obrazu, radio, telewizje itp.) oraz media umożliwiające zapis informacji (pamięci przenośne, dyski twarde, dyski CD/DVD, taśmy itp.), a także sprzęt umożliwiający przetwarzanie informacji (komputery osobiste, serwery, klastry, sieci komputerowe itp.). Ponadto technologie ICT obejmują gamę aplikacji informatycznych oraz złożonych systemów IT umożliwiających realizację przetwarzania i przesyłania danych na wyższym poziomie abstrakcji niż poziom sprzętowy.

Literatura [1] http://www.smart-cities.eu/ [2] Najwyższa Izba Kontroli, Informacja o wynikach kontroli „Funkcjonowanie miejskiego monitoringu wizyjnego”. [3] Tamże. [4] P. Wittich, Skuteczna obserwacja wymaga dobrego zarządzania, „a&s Polska”, 2/2017. [5] Informacja prasowa Canona z 7.09.2015 r., http://global.canon/en/news/2015/sep07e.html [6] M.L. Garcia, The design and evaluation of physical protection systems, Butterworth-Heinemann 2001r. [7] A.H. Tickner, E.C. Poulton, Monitoring up to 16 Synthetic Television Pictures Showing a Great Deal of Movement. Ergonomics (14)4, 1973 r. [8] PSDB – (Police Scientific Development Branch) Policyjny Departament Rozwoju Technicznego przy Ministerstwie Spraw Wewnętrznych w Wielkiej Brytanii został powołany do przeprowadzenia niezależnych badań zwiększenia skuteczności wykorzystywanych technologii w zapobieganiu przestępstw. W roku 1992 zapoczątkował on program How it Works, poprawy ergonomii i wykorzystania stanowisk monitoringu wizyjnego i alokacji punktów kamerowych. (http://www.crimereduction.home.office.gov.uk) [9] E. Wallace, C. Diffley, CCTV: Making It Work. CCTV Control Room. Ergonomics, PSDB 14/98. [10] Nauka o pracy – bezpieczeństwo, higiena, ergonomia, pakiet edukacyjny dla uczelni wyższych, prof. dr hab. med. Bolesław Gwóźdź, Śląska Akademia Medyczna, http://nop.ciop.pl/ [11] Na podstawie Rozporządzenia Ministra Pracy i Polityki Socjalnej z dnia 1 grudnia 1998 r. w sprawie bezpieczeństwa i higieny pracy na stanowiskach wyposażonych w monitory ekranowe (DzU 1998.148.973) i Display Screen Equpment Work – Guidance on Regulations (ISBN 0717604101). [12] G. Modliński, Inteligentne systemy monitoringu wizyjnego, 2005. [13] https://pl.wikipedia.org/wiki/Big_data [14] Raport Deloitte, Smart Cities, Biga Data, styczeń 2015. [15] http://www.unicard.pl/blog/3-najbardziej-inteligentne-miasta-swiata-smart-city/

![[FOTORELACJA] Jesienny Bootcamp – wymiana doświadczeń i testowanie urządzeń](https://aspolska.pl/wp-content/uploads/2023/10/IMG_0004-180x135.jpg)

![[Fotorelacja] Wsparcie operacji a bezpieczeństwo – warsztaty EST i Genetec](https://aspolska.pl/wp-content/uploads/2023/10/DSC0395-Avec-accentuation-NR-1m2-180x135.jpg)

![[RELACJA] Za nami 24. Konferencja Branży Ochrony](https://aspolska.pl/wp-content/uploads/2023/10/pio2023-180x135.jpg)

![[ZAPOWIEDŹ] Wprowadzenie do serii REDSCAN mini-Pro – Webinar OPTEX](https://aspolska.pl/wp-content/uploads/2023/10/webinar_optex-180x135.jpg)

![[FOTORELACJA] Nedap Security Day](https://aspolska.pl/wp-content/uploads/2023/10/1_image00102-2-180x135.jpeg)

![[WIDEORELACJA] Konferencja Warsaw Security Summit 2023](https://aspolska.pl/wp-content/uploads/2023/06/IMG_0256-180x135.jpg)

![[VIDEORELACJA] Security Bootcamp 2023 – edycja wiosenna](https://aspolska.pl/wp-content/uploads/2023/06/IMG_2145-180x135.jpg)

![[WIDEORELACJA] Security Bootcamp 2022 – II edycja](https://aspolska.pl/wp-content/uploads/2022/10/IMG_0205-180x135.jpg)

![[WIDEORELACJA] Security BootCamp2022](https://aspolska.pl/wp-content/uploads/2022/07/IMG_3761-180x135.jpg)

![[WIDEORELACJA] Konferencja Warsaw Security Summit 2022](https://aspolska.pl/wp-content/uploads/2022/06/wss_2022_IMG_4219-180x135.jpg)

![[FOTORELACJA] Jesienny Bootcamp – wymiana doświadczeń i testowanie urządzeń](https://aspolska.pl/wp-content/uploads/2023/10/IMG_0004-238x178.jpg)

![[CZYTAJ ONLINE] 3/2021 a&s Polska](https://aspolska.pl/wp-content/uploads/2021/06/01_3_2021_02-100x75.jpg)