Roboty i coboty w systemach safety @ security osób i mienia

Marek Ryszkowski

Wszyscy doskonale wiedzą, co oznacza termin „robot”, termin „cobot” natomiast nie jest jeszcze zbyt powszechnie znany. Coboty to nowa generacja robotów, które są tak skonstruowane i oprogramowane, że powinny bezpiecznie dla człowieka współpracować z nim we wspólnej strefie roboczej na tym samym stanowisku pracy, co było niemożliwe i niedopuszczalne przez bhp w przypadku starszych generacji robotów.

Coboty są tak przygotowywane do pracy na wspólnym z człowiekiem stanowisku pracy, żeby zareagować na zetknięcie z człowiekiem i natychmiast zatrzymać się, gdyby groziło to uszkodzeniem kruchego ludzkiego ciała1). Pierwsze modele cobotów weszły już podobno do produkcji seryjnej. Wydaje się, że ich rozpowszechnianie na zrobotyzowanych liniach produkcyjnych (i innych) jest procesem nie do powstrzymania. Są jednak specjaliści robotyki, czyli nauki o robotach, której prekursorem był Isaac Asimov2), autor tzw. praw robotyki, którzy uważają, że nie można zagwarantować bezwzględnego bezpieczeństwa człowieka we współpracy z cobotem. W działaniu robotów, a cobot jest przecież ich szczególną wersją (odmianą), zaobserwowano bowiem zjawisko polegające na niespodziewanym wykonaniu przez robota czynności, która nie była dla niego zaprogramowana i której on nigdy wcześniej, nawet podczas pracy liczonej w setkach lub tysiącach roboczogodzin, nie wykonał. Taki incydent nazwano stanem lub cyklem nieustalonym robota.

Dotychczas strefy pracy robotów i ludzi były ściśle rozgraniczane m.in. z tego właśnie powodu. W przypadku współpracy człowieka z cobotem na tym samym stanowisku pracy strefy te nie będą rozgraniczone, chociaż niekoniecznie muszą się pokrywać, mogą być bowiem częściowo rozgraniczone. Trzeba wspomnieć, że na pewnej konferencji naukowej specjalistów robotyki podano informację, że w Japonii cobot zabił współpracującego z nim człowieka, „wpadając w stan nieustalony”, bo „człowiek ten za wolno pracował, opóźniając wykonywanie przez cobota jego czynności na wspólnym stanowisku pracy”.

Wyraz COBOT jest akronimem angielskiej nazwy określonego typu robota, czyli collaborative robot. Termin ROBOT natomiast ma pochodzenie słowiańskie, wyprowadzone z wyrazu robota, czyli praca, przez czeskiego literata Karela Čapka już w roku 1921. Terminu ROBOTYKA po raz pierwszy użył Isaac Asimov w 1938 r. On też sformułował trzy prawa robotyki, zatem słusznie jest uważany za twórcę tej nauki.

Od lutego 2017 r. Unia Europejska zainicjowała prace nad opracowaniem zasad dotyczących wytwarzania i etyki funkcjonowania robotów w krajach członkowskich. Poza mało konkretnymi planami (prace dopiero ruszają i nie są prowadzone w trybie urgent, czyli cito) warto zwrócić uwagę na to, że zaproponowano, by były oparte na trzech asimowskich prawach robotyki i dodatkowym prawie zerowym, sformułowanym później.

***

W systemach ochrony osób i mienia urządzenia robotopodobne już są obecne, a coboty znajdą wkrótce (już eksperymentalnie znajdują) zastosowanie. Nie zawsze zdajemy sobie sprawę z tego, że np. system kontroli dostępu do strefy, pomieszczenia lub urządzenia podlegającego ochronie przed dostępem osób niepowołanych (nieuprawnionych) ma cechy prostego pod względem sprzętu i oprogramowania robota, który ma sprawdzić i ocenić, czy osoba podejmująca próbę wejścia lub dostępu do nich należy do zbioru osób uprawnionych (powołanych) do tego, czy też nie należy. Od jakości tego quasi-robota zależy, jak nikłe jest prawdopodobieństwo popełnienia przez niego niebezpiecznego błędu drugiego rodzaju, czyli uznania osoby nieuprawnionej (nieupoważnionej) za uprawnioną (upoważnioną), co skutkuje odblokowaniem wejścia (dostępu) i niewysłaniem sygnału alarmu do centrum dozorowania. Podobną analizę, która może wydać się niektórym robotykom nieco ryzykowna intelektualnie, można przeprowadzić w stosunku do innych elementów systemu ochrony osób i mienia, np. systemu telewizji dozorowej, zwłaszcza wyposażonego w kamery uruchamiane przez ruch obiektu w strefie dozorowania danej kamery.

W systemach ochrony osób i mienia urządzenia robotopodobne już są obecne, a coboty znajdą wkrótce (już eksperymentalnie znajdują) zastosowanie. Nie zawsze zdajemy sobie sprawę z tego, że np. system kontroli dostępu do strefy, pomieszczenia lub urządzenia podlegającego ochronie przed dostępem osób niepowołanych (nieuprawnionych) ma cechy prostego pod względem sprzętu i oprogramowania robota, który ma sprawdzić i ocenić, czy osoba podejmująca próbę wejścia lub dostępu do nich należy do zbioru osób uprawnionych (powołanych) do tego, czy też nie należy. Od jakości tego quasi-robota zależy, jak nikłe jest prawdopodobieństwo popełnienia przez niego niebezpiecznego błędu drugiego rodzaju, czyli uznania osoby nieuprawnionej (nieupoważnionej) za uprawnioną (upoważnioną), co skutkuje odblokowaniem wejścia (dostępu) i niewysłaniem sygnału alarmu do centrum dozorowania. Podobną analizę, która może wydać się niektórym robotykom nieco ryzykowna intelektualnie, można przeprowadzić w stosunku do innych elementów systemu ochrony osób i mienia, np. systemu telewizji dozorowej, zwłaszcza wyposażonego w kamery uruchamiane przez ruch obiektu w strefie dozorowania danej kamery.

Coboty w systemach ochrony osób i mienia będą zapewne robotami wielozadaniowymi, chociaż dopiero czas pokaże, czy będą one w stanie bezpiecznie dla ludzi zastąpić pracowników ochrony fizycznej w niektórych czynnościach, przypisanych im przez ustawę o ochronie osób i mienia oraz rozporządzenia wydane na podstawie delegacji tej ustawy. Nie ulega jednak wątpliwości, że będą one wykonywały nie tylko zadania bierne – obserwację chronionych stref, pomieszczeń i/lub obiektów oraz wysyłanie lub nie sygnałów alarmu do centrów dozorowania – ale także mogą być im przypisane niektóre czynności aktywne, np. kierowców samochodów patroli interwencyjnych. Wszak np. w USA już trwają intensywne prace nad skonstruowaniem bezpiecznego samochodu autonomicznego, który będzie mógł się poruszać po drogach publicznych bez udziału kierowcy człowieka. Wprawdzie zdarzył się już wypadek drogowy w USA z udziałem takiego samochodu, z dostępnych informacji wynika jednak, że to nie cobot nim kierujący był jego sprawcą.

Innym problemem, znacznie poważniejszym, jest użycie cobota zamiast człowieka – pracownika ochrony fizycznej do czynności interwencyjnych za pomocą np. środków przymusu bezpośredniego w postaci np. gazu łzawiącego. Na razie chyba nie wyobrażamy sobie, by cobot mógł paradować jako element systemu ochrony fizycznej np. ważnego obiektu infrastruktury krytycznej, podlegającego ochronie przez SUFO, z bronią palną w futerale przy boku lub przewieszoną przez plecy na pasie nośnym. Zresztą coboty, nawet uzbrojone, chyba nie będą mogły mieć humanoidalnych kształtów. Wydaje się, że na początek coboty o odstraszającym wyglądzie samą posturą mogą zniechęcić potencjalnych złoczyńców od naruszania granic stref ochronnych, których strzegą także one, będąc bezwzględnie posłusznymi woli człowieka, który czuwa, nadzorując ich działanie. Pamiętajmy jednak, że są już drony, obiekty na- i podwodne oraz lądowe uzbrojone w potężne uzbrojenie, o którego użyciu decyduje człowiek nieraz z odległości wielu tysięcy kilometrów (dot. dronów, które operują w przestrzeni powietrznej) i które już obecnie mogą uzyskać autonomię działania, gdy człowiek tak zdecyduje. Zatem już dzisiaj nic nie stoi na przeszkodzie, by uzbrojone drony patrolowały granice np. rozległych terenów chronionych (portów morskich, lotnisk, baz wojskowych itd.), z możliwością czynnego reagowania posiadanym uzbrojeniem na próby nieuprawnionego naruszenia granic tych terenów. Na razie pod kontrolą operatora systemu i na jego sygnał, lecz w przyszłości…? Warto zatem, by menedżerowie firm branży security pochylili się, jeśli jeszcze tego nie zrobili, nad problemem (ekonomicznym i innym) wykorzystania robotów w wersji cobot w systemach ochrony fizycznej osób i mienia. Jak zgodnie głoszą specjaliści robotyki, to przyszłość tej branży i wielu innych.

***

W obowiązujących normach polskich i europejskich można znaleźć regulacje przydatne w organizowaniu w miarę bezpiecznej współpracy ludzi i robotów, w tym cobotów, we wspólnej (częściowo lub całkowicie) strefie roboczej na tym samym stanowisku pracy, w zrobotyzowanych przemysłowych liniach produkcyjnych. Podobnych regulacji w odniesieniu stricte do cobotów współpracujących z pracownikami ochrony fizycznej lub pracownikami zabezpieczenia technicznego w systemach ochrony osób i mienia, nie udało się autorowi znaleźć w ogólnie dostępnych zasobach Internetu. Zatem dla przybliżenia problemu przedstawiono niżej, jak taką współpracę powinno się organizować w zrobotyzowanych przemysłowych liniach produkcyjnych.

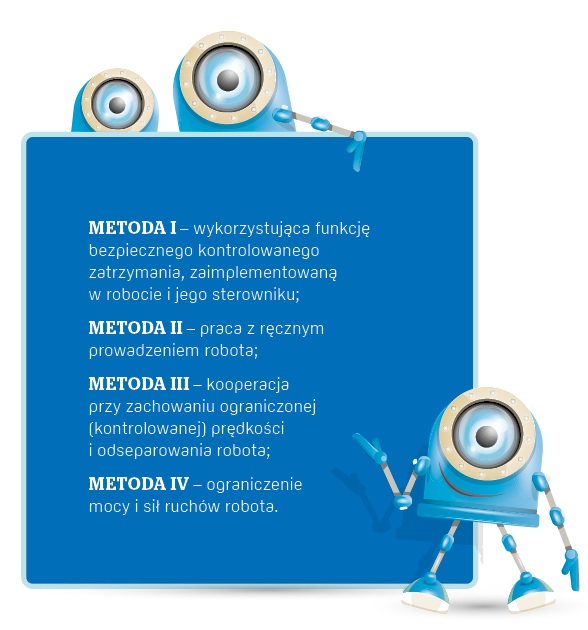

Rodzaje współpracy człowieka z technicznymi urządzeniami elektromechanicznymi, które można odnieść przynajmniej częściowo do robotów, cobotów, już określa kilka polskich i europejskich norm. Zasady te można podzielić na cztery podstawowe metody.

Do pierwszych trzech doskonale nadają się również klasyczne roboty przemysłowe, ale odpowiednio skonstruowane lub dodatkowo wyposażone w zewnętrzną aparaturę. Metoda czwarta to tryb współpracy zakładający wykorzystanie cobotów.

Do pierwszych trzech doskonale nadają się również klasyczne roboty przemysłowe, ale odpowiednio skonstruowane lub dodatkowo wyposażone w zewnętrzną aparaturę. Metoda czwarta to tryb współpracy zakładający wykorzystanie cobotów.

Metoda I

Jest powszechnie stosowana w różnego rodzaju liniach montażowych, klatkach spawalniczych lub zgrzewalniczych oraz pomieszczeniach (celach) lakierniczych, W tej metodzie przestrzeń wokół robota jest wyznaczona i nadzorowana poprzez ograniczające go środki ochronne, takie jak różnego rodzaju osłony mechaniczne bądź aparatura optoelektroniczna. Rola operatora ogranicza się do odbioru poprzedniego i załadunku kolejnego przedmiotu obrabianego do chwytaka robota lub dostarczenia do celi kolejnego obiektu do lakierowania. Jeżeli w trakcie realizacji tego zadania operator przebywa w przestrzeni pracy robota, jest on najczęściej wykrywany przez środki detekcji. Ich reakcja wymusza wyzwolenie w sterowaniu robota tzw. bezpiecznego kontrolowanego zatrzymania. Jest ono zazwyczaj realizowane w kategorii 2 zatrzymywania wg PN-EN 60204-1 (Bezpieczeństwo maszyn – Wyposażenie elektryczne maszyn – Część 1: Wymagania ogólne) – to znaczy z kontrolą bezruchu i pozostawieniem zasilania na napędach osi robota (np. w celu zachowania określonych parametrów technologicznych). W przypadku nieoczekiwanego ruchu robota dochodzi do jego detekcji i bezzwłocznego odłączenia zasilania napędów, czyli tzw. kategorii 0 zatrzymywania wg PN-EN 60204-1. Tuż po załadunku operator opuszcza przestrzeń nadzorowaną, co wyzwala automatycznie cykl produkcyjny lub sam wyzwala go ręcznie. Wówczas pomiędzy operatorem a robotem musi funkcjonować skuteczny system odgradzający. W przypadku jego naruszenia ruch robota i inne operacje w procesie technologicznym zostają bezpiecznie zatrzymane, podobnie jak w przypadku wykrycia nieoczekiwanego ruchu robota w trakcie przestoju.

Metoda II

Zakłada wykorzystanie robota jako urządzenia wspomagającego, automatyzującego procesy montażowe czy poprawiającego ergonomię pracy. Klasycznym przykładem jest np. wsparcie przy instalacji foteli w autach na liniach produkcyjnych, gdzie robot odciąża montażystę. W tym trybie pracy ruch robota odbywa się na wyraźne żądanie obsługującego. Sterowanie robotem jest realizowane za pomocą obu rąk, z użyciem urządzeń zezwalających, z funkcją podtrzymywania, zabudowanych w oprzyrządowaniu technologicznym. W zależności od pozostałych zagrożeń i od wyboru urządzenia zezwalającego praca z robotem będzie możliwa tylko przy aktywacji przycisków dwustanowych lub tylko przy aktywacji przycisków trójstanowych (w pozycji środkowej aktywowanej z odpowiednią siłą). W trakcie ruchu robota jego prędkość jest ograniczona do wartości bezpiecznej, wynikającej z oceny ryzyka. W przypadku jej przekroczenia ruchy robota ulegają zatrzymaniu. Konieczne jest więc w tej metodzie stosowanie funkcji bezpieczeństwa dla napędów, opisanych w normie PN-EN 61800-5-2 (Elektryczne układy napędowe mocy o regulowanej prędkości – Część 5-2: Wymagania dotyczące bezpieczeństwa).

Metoda III

Zakłada dodatkowe wyposażenie robota lub aplikacji w aparaturę wykrywającą człowieka w pełnej przestrzeni, wykraczającej poza maksymalną przestrzeń określoną z możliwości ruchów robota. W przypadku detekcji zbliżania się człowieka do strefy pracy robota robot spowalnia swoje ruchy do prędkości bezpiecznych, wynikających z oceny ryzyka, by utrzymać bezpieczną odległość separacji pomiędzy swoimi elementami a wykrytym w strefie człowiekiem. Gdy jest to konieczne dla kontynuacji zadania, robot powinien mieć zdolność modyfikacji trajektorii ruchu, zachowując przy tym bezpieczną odległość separacji. Kiedy odległość separacji nie może być dłużej zachowana, wówczas robot przechodzi w bezpieczne kontrolowane zatrzymanie (podobnie w metodzie I). Jest to metoda pracy stosowana najrzadziej ze względu na nadal istniejące ograniczenia w zakresie rozwiązań bezpieczeństwa. Docelowo niezbędne jest tu rozwiązanie, które będzie dynamicznie reagować na ruchy człowieka w przestrzeni pracy robota i jej sąsiedztwie.

Metoda IV

Narzuca konieczność wykorzystania cobotów. Dzięki specjalnie zaprojektowanym robotom w wyniku ich kontaktu z ciałem człowieka (lub inną przeszkodą) dochodzi do zatrzymania ruchu bądź wycofania ramienia roboczego. To samo wymaganie dotyczy również wyposażenia technologicznego i przedmiotu obrabianego. Z punktu widzenia bezpieczeństwa krytyczne jest tutaj ograniczenie parametrów ruchu cobota do wartości brzegowych przyjętych na etapie oceny ryzyka.

Jest wysoce prawdopodobne, że do zapewnienia bezwzględnie bezpiecznej współpracy cobota z człowiekiem we wspólnej strefie roboczej nigdy nie dojdzie. Osiągnięcie akceptowalnego poziomu bezpieczeństwa takiej współpracy natomiast jest możliwe po aplikacji cobotom tzw. sztucznej inteligencji, nad czym trwają intensywne prace robotyków.

***

Wobec podjętych przez Unię Europejska w lutym 2017 r. prac, o których była mowa wyżej, pojawia się wiele pytań, w tym:

– Czy niezbędna stanie się modyfikacja praw robotyki Isaaca Asimova?

– Jakie mogą być kierunki takiej modyfikacji?

– Czy i jak wpłyną one na dalszy rozwój robotyki?

Poszukiwania odpowiedzi na te pytania są obecnie przyczyną burzy mózgów w środowiskach robotyków, którzy z jednej strony upatrują wielką szansę dla rozwoju robotyki w implementacji robotom sztucznej inteligencji, z drugiej natomiast – obawiają się zagrożeń, nie do końca jeszcze zdefiniowanych, dla ludzi i ludzkości ze strony robotów, wyposażonych w sztuczną inteligencję.

Coboty w systemach ochrony osób i mienia będą zapewne robotami wielozadaniowymi, chociaż dopiero czas pokaże, czy będą one w stanie bezpiecznie dla ludzi zastąpić pracowników ochrony fizycznej w niektórych czynnościach, przypisanych im przez ustawę o ochronie osób i mienia oraz rozporządzenia wydane na podstawie delegacji tej ustawy.

Coboty w systemach ochrony osób i mienia będą zapewne robotami wielozadaniowymi, chociaż dopiero czas pokaże, czy będą one w stanie bezpiecznie dla ludzi zastąpić pracowników ochrony fizycznej w niektórych czynnościach, przypisanych im przez ustawę o ochronie osób i mienia oraz rozporządzenia wydane na podstawie delegacji tej ustawy.

| Trzy prawa robotyki Isaaca Asimova |

| 1. Robot nie może skrzywdzić istoty ludzkiej lub – poprzez wstrzymanie się od działania – pozwolić, by stała się jej krzywda. 2. Robot musi wykonywać rozkazy wydawane mu przez istoty ludzkie, z wyjątkiem sytuacji, kiedy byłyby one sprzeczne z prawem pierwszym. 3. Robot musi chronić swoje istnienie dopóty, dopóki taka ochrona nie jest sprzeczna z prawem pierwszym lub prawem drugim. |

Następcy Isaaca Asimova sformułowali jeszcze jedno prawo robotyki, określone jako prawo 0, czyli zerowe. Brzmi ono:

| Robot nie może skrzywdzić ludzkości lub przez zaniechanie działania doprowadzić do uszczerbku dla ludzkości. |

Opracowano na podstawie informacji uzyskanych w ogólnie dostępnych zasobach Internetu.

1) Juliusz Ćwieluch, Robota z robotami. „Polityka” nr 50 (3190). 2) Isaac Asimov (1920–1992) – amerykański pisarz i profesor biochemii pochodzenia rosyjsko-żydowskiego.

Marek Ryszkowski

dr inż., ekspert KSOIN, autor licznych artykułów i kilku książek z zakresu prawa ochrony informacji niejawnych, były pełnomocnik ochrony informacji niejawnych w kilku podmiotach prawa handlowego.